Séminaire I&M, par Sabrine Djedjiga OUCHERIF

Sabrine Djedjiga OUCHERIF

Titre : Apports d’un système de vision plénoptique pour l’analyse des comportements

Résumé :

CONTEXTE

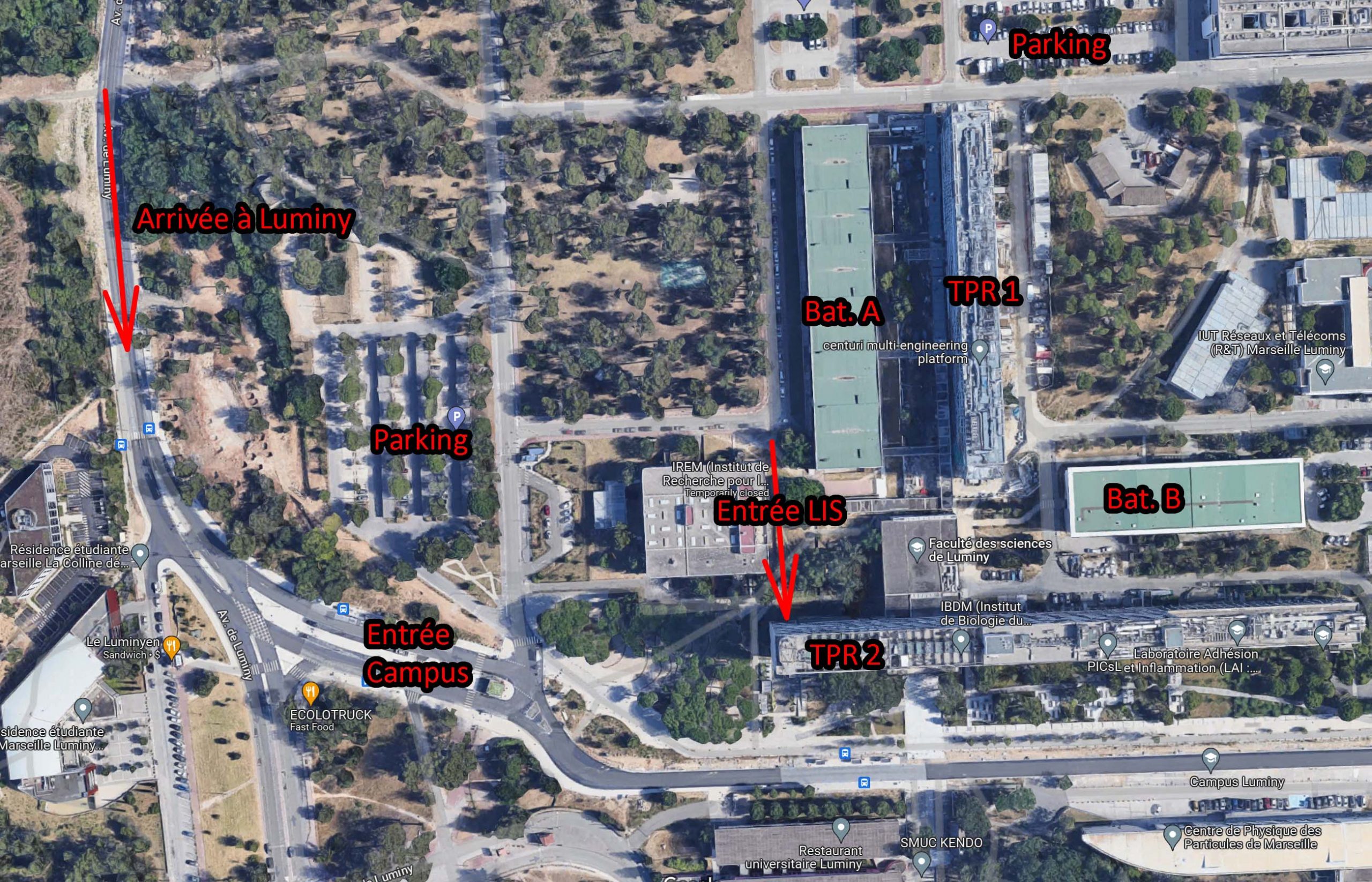

Depuis plusieurs décennies, la reconnaissance des expressions faciales est reconnue comme une méthode essentielle pour l’analyse approfondie des émotions humaines, constituant un pilier de l’analyse comportementale moderne. Aujourd’hui, notre compréhension de ce domaine est renforcée par l’intégration de la recherche académique avec des technologies avancées. Le Centre d’Étude et de Recherche en Gestion d’Aix Marseille (CERGAM), en collaboration avec le Laboratoire d’Informatique et Systèmes (LIS) et l’Institut de Mathématiques de Marseille (I2M), explore des applications de ces méthodes au marketing. Grâce aux caméras plénoptiques, qui capturent l’intensité et la direction des rayons lumineux, nous obtenons des images multiperspectives en une seule prise [1, 2]. Ces images, en facilitant la création de cartes de profondeur détaillées, améliorent notre capacité à analyser les nuances des expressions faciales, enrichissant ainsi notre compréhension des réactions émotionnelles des consommateurs.

OBJECTIFS

L’objectif final de ce projet est d’analyser le comportement des personnes dans un espace de vente, en mettant l’accent sur l’étude et la reconnaissance des expressions faciales. Pour ce faire, nous utiliserons des caméras plénoptiques, qui fournissent des images de sous-ouverture, des images total focus ainsi que des cartes de profondeur. Ces divers types d’images nous permettront de capturer des données riches et variées sur les interactions des consommateurs. Nous nous appuierons sur des architectures innovantes combinant des réseaux de neurones convolutifs (CNN) et récurrents (RNN) pour extraire les informations spatiales et angulaires contenues dans les données capturées par les caméras plénoptiques. L’approche de fusion multimodale sera utilisée pour intégrer et traiter ces différentes informations, afin de fournir une analyse comportementale précise et approfondie des consommateurs.

[1] T. -W. Shen et al., “Facial expression recognition using depth map estimation of Light Field Camera,” 2016 IEEE International Conference on Signal Processing, Communications and Computing(ICSPCC), 2016, pp.1-4, doi: 10.1109/ICSPCC.2016.7753695.

[2] A. Sepas-Moghaddam, A. Etemad, F. Pereira and P. L. Correia, “Facial Emotion Recognition Using Light Field Images with Deep Attention-Based Bidirectional LSTM,” ICASSP 2020 – 2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), 2020, pp. 3367-3371, doi: 10.1109/ICASSP40776.2020.9053919.