Séminaire I&M, par Sabrine djedjiga OUCHERIF

Sabrine djedjiga OUCHERIF

Titre : APPORTS D’UN SYSTÈME DE VISION PLÉNOPTIQUE POUR L’ANALYSE DES COMPORTEMENTS.

Résumé :

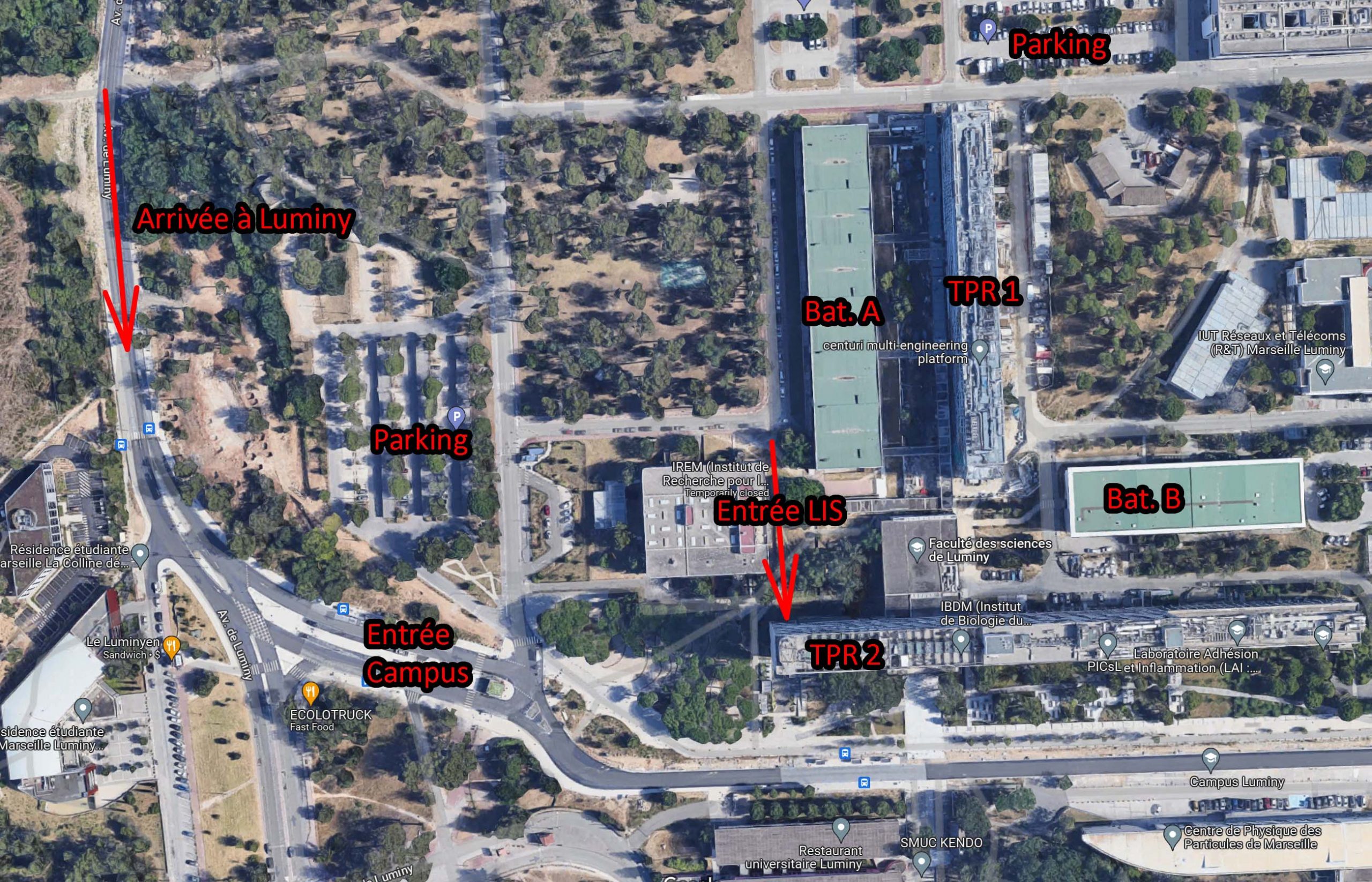

La reconnaissance des expressions faciales constitue depuis plusieurs décennies une méthode de choix pour l’analyse fine des émotions humaines, et représente un enjeu majeur dans l’étude du comportement. Dans une perspective de recherche interdisciplinaire, ce domaine s’enrichit aujourd’hui grâce à l’intégration de travaux académiques pointus et de technologies avancées. Ce projet s’inscrit dans une collaboration entre le Centre d’Étude et de Recherche en Gestion d’Aix Marseille (CERGAM), le Laboratoire d’Informatique et Systèmes (LIS) et l’Institut de Mathématiques de Marseille (I2M). L’utilisation de caméras plénoptiques, capables de capturer simultanément l’intensité et la direction des rayons lumineux, permet d’obtenir des images multi-perspectives en une seule acquisition [1, 2]. Ces images facilitent la génération de cartes de profondeur détaillées et optimisent l’analyse des subtilités des expressions faciales, offrant ainsi un éclairage nouveau sur les réponses émotionnelles des consommateurs.

Ce projet vise à approfondir l’analyse comportementale des individus en environnement de vente en se focalisant sur l’étude et la reconnaissance des expressions faciales. À cet effet, nous mobilisons des dispositifs de capture avancés (caméras plénoptiques) fournissant une diversité d’images, incluant des prises de vue en sous-ouverture, en total focus et des cartes de profondeur. Ces différents supports permettent de constituer un jeu de données riche et varié, indispensable à une analyse fine des interactions en situation réelle.

Pour traiter ces données, nous proposons d’implémenter des architectures hybrides combinant réseaux de neurones convolutifs (CNN) et récurrents (RNN), afin d’extraire efficacement les informations spatiales et temporelles. Par ailleurs, l’adoption d’une approche de fusion multimodale constitue un levier majeur pour intégrer et exploiter l’ensemble des modalités capturées, dans le but d’obtenir une analyse comportementale précise et approfondie

[1] T. -W. Shen et al., “Facial expression recognition using depth map estimation of Light Field Camera,” 2016 IEEE International Conference on Signal Processing, Communications and Computing(ICSPCC), 2016, pp.1-4, doi: 10.1109/ICSPCC.2016.7753695.

[2] A. Sepas-Moghaddam, A. Etemad, F. Pereira and P. L. Correia, “Facial Emotion Recognition Using Light Field Images with Deep Attention-Based Bidirectional LSTM,” ICASSP 2020 – 2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), 2020, pp. 3367-3371, doi: 10.1109/ICASSP40776.2020.9053919